Tensorflow: ¿Puedo exportar un modelo entrenado por gpu a una máquina solo con cpu para servir / evaluar?

Entrené un modelo en una máquina GPU.

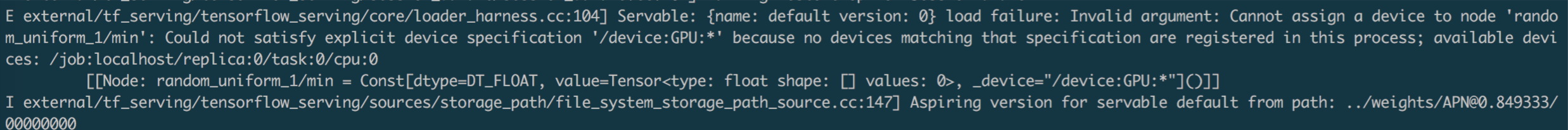

Cuando cargo un modelo de este tipo en una máquina que solo tiene CPU, aparece el siguiente error.

¡Gracias por cualquier sugerencia!

awaiting tensorflower

Todos 3 comentarios

@vrv ¿Podrías echarle un vistazo a esto, por favor? ¿Tenemos ese apoyo ahora? Gracias.

Sí, puede pasar tf.ConfigProto (allow_soft_placement = True) a tf.Session si realmente desea ignorar las directivas de ubicación de dispositivos en el gráfico. No soy un gran fanático de usar esta opción (prefiero que se reescriba el gráfico para eliminar los campos del dispositivo explícitamente), pero eso debería funcionar.

Además, en el futuro, StackOverflow es el lugar adecuado para hacer estas preguntas.

¿Fue útil esta página

0 / 5 - 0 calificaciones

Comentario más útil

Además, en el futuro, StackOverflow es el lugar adecuado para hacer estas preguntas.