저는 1.2.1 버전을 개발용으로 사용하고 있습니다. 파이썬으로 설치가 쉽기 때문입니다. 또한 c_api를 사용하여 예측을 위한 간단한 c 코드를 작성하고 있습니다. v1.2.1 libxgboost.so에 연결된 경우 python과 c 간의 예측 차이는 정확히 0입니다. 그러나 마스터 브랜치에서 libxgboost.so로 연결하면(2020년 11월 5일 f3a425398 커밋) 차이가 있습니다.

정적 lib를 구축하고 싶기 때문에 master 브랜치를 사용하여 실제 시스템에 c 코드를 배포하고 싶습니다. 이제 v1.2.1과 master 브랜치의 예측 차이가 저를 방해합니다.

감사 해요.

모든 35 댓글

버그를 재현할 수 있도록 예제 프로그램을 게시할 수 있습니까?

또한 Python 패키지의 마스터 버전과 C API의 예측이 다른가요?

CPU 예측자에서 수행된 일부 최적화가 있으며 다른 부동 소수점 오류로 인해 다른 결과를 생성할 수 있습니다. 그러나 예, 재현 가능한 예가 있습니까?

또한 Python 패키지의 마스터 버전과 C API의 예측이 다른가요?

python 패키지의 v1.2.1과 C API의 마스터 브랜치를 비교하고 있습니다.

@7starsea 마스터 브랜치의 Python과 C API의 출력도 비교할 수 있습니까? 문제는 애플리케이션에서 C API 함수가 사용되는 방식일 수 있습니다.

@7starsea 마스터 브랜치의 Python과 C API의 출력도 비교할 수 있습니까? 문제는 애플리케이션에서 C API 함수가 사용되는 방식일 수 있습니다.

나는 v1.2.1의 python과 c api를 비교했고 예측은 정확히 동일합니다.

@7starsea 알겠습니다. 동일한 모델에서 예측하는 Python 및 C 프로그램을 모두 게시하면 문제를 추가로 해결할 수 있습니다.

@hcho3 은 테스트 코드입니다.

@7starsea 방금 귀하의 예를 시도하고 다음과 같은 결과를 얻었습니다.

difference: [0. 0. 0. 0.] 0.0 0.0

XGBoost의 최신 커밋(debeae2509d90ec1d3402a3a185fba7a25113ff1)을 사용했습니다.

@7starsea 아니요, 최신 소스(commit debeae2509d90ec1d3402a3a185fba7a25113ff1)에서 XGBoost를 컴파일 했으므로 v1.2.1보다 최신입니다. 내 XGBoost Python 패키지는 xgboost.__version__ 필드에 대해 1.3.0-SNAPSHOT 를 인쇄합니다.

@hcho3 XGBoost 가 다른 버전(최소한 연속 버전) 간에 일관된 예측을 유지해야 하는지 궁금합니다.

또한 v1.3.0의 출시를 기대하고 있습니다.

(지금 마스터 브랜치를 사용하여 모델을 훈련시켜야 할 것 같습니다)

시간 내 줘서 고마워.

@7starsea 이전 버전에서 저장된 모델을

귀하의 스크립트를 사용하여 문제를 재현할 수 없습니다. Docker 이미지나 VM 이미지를 빌드하고 공유해 주시겠습니까?

@7starsea 참고로, 다음과 같이 소스에서 XGBoost 1.2.1 빌드도 시도했습니다.

git clone --recursive https://github.com/dmlc/xgboost -b release_1.2.0 xgb_source

cd xgb_source

mkdir build

cd build

cmake ..

make

cd ../python-package

python setup.py install

결과가 다시 difference: [0. 0. 0. 0.] 0.0 0.0

차이점을 확인하려면 두 가지 버전의 XGBoost, Python용 v1.2.1 및

dtest = xgb.DMatrix(rx, missing=0.0)

y1 = m2.predict(dtest) # # internally using libxgboost.so v1.2.1

그리고 하나는 cpp용

m1 = XgbShannonPredictor(fname)

y2 = m1.predict(rx2) # # internally using libxgboost.so from the master branch (debeae2)

나는 (나에게 새로운) 도커 이미지를 만들려고 노력할 것이다.

한 번 볼게요.

나는 (나에게 새로운) 도커 이미지를 만들려고 노력할 것이다.

필요하지 않습니다.

실제로 문제를 재현하는 데 성공했습니다. XGBoost의 dev 버전은 XGBoost 1.2.0과 다른 예측을 생성하는 것으로 나타났습니다. 그리고 문제는 재현하기 쉽습니다. C API를 사용할 필요가 없습니다.

재현 가능한 예(편집: 랜덤 시드 설정):

import numpy as np

import xgboost as xgb

rng = np.random.default_rng(seed=2020)

rx = rng.standard_normal(size=(100, 127 + 7 + 1))

rx = rx.astype(np.float32, order='C')

m2 = xgb.Booster({'nthread': '4'}) # init model

m2.load_model('xgb.model.bin') # load data

dtest = xgb.DMatrix(rx, missing=0.0)

y1 = m2.predict(dtest)

print(xgb.__version__)

print(y1)

1.2.0의 출력:

1.2.0

[ 0.00698659 -0.00211251 0.00180039 -0.00016004 0.00526169 0.00801963

0.00016755 0.00226218 0.00276762 0.00408182 0.00303206 0.00291929

0.01101092 0.0068329 0.00145864 0.00326979 0.00572816 0.01019934

0.00074345 0.00784767 0.00173795 -0.00219297 0.0060181 0.00606489

0.00447372 0.00103396 0.00932363 0.00230178 0.00389203 0.00151157

0.0034163 0.00821933 0.006686 0.00630778 0.00331488 0.00775066

0.00443819 0.01030204 0.00924486 0.00645933 0.00777653 0.00231206

0.00457835 0.00390425 0.00947028 0.00410065 0.00220913 0.00292507

0.00637993 0.00796807 0.00140873 0.00887537 0.00496858 0.01049942

0.00908098 0.00332722 0.00799242 0.00228494 0.00463879 0.00213429

0.00729388 0.01049232 0.00790522 0.01269361 -0.00425893 0.00256333

0.00859573 0.00472835 0.00077197 0.00191873 0.01546788 0.0014475

0.00888193 0.00648022 0.00115797 0.00351191 0.00580138 0.00614035

0.00632426 0.00408354 0.00346044 -0.00034332 0.00599384 0.00302595

0.00657633 0.01086903 0.00625807 0.00096565 0.00061804 0.00038511

0.00523874 0.00633043 0.00379965 0.00302553 -0.00123322 0.00153473

0.00725579 0.00836438 0.01295918 0.00737873]

메모. XGBoost 1.0.0 및 1.1.0으로 스크립트를 실행하면 1.2.0과 동일한 출력이 생성됩니다.

개발 버전의 출력(c5645180a6afb9d3d771165e681985fe3522adf6)

1.3.0-SNAPSHOT

[ 0.00698666 -0.00211278 0.00180034 -0.00016027 0.00526194 0.00801962

0.00016758 0.00226211 0.00276773 0.00408198 0.00303223 0.00291933

0.01101091 0.00683288 0.00145871 0.00326988 0.00572827 0.01019943

0.00074329 0.00784767 0.00173803 -0.00219286 0.00601804 0.00606472

0.00447388 0.00103391 0.00932358 0.00230171 0.003892 0.00151177

0.00341637 0.00821943 0.00668607 0.00630774 0.00331502 0.00775074

0.0044381 0.01030211 0.00924495 0.00645958 0.00777672 0.00231205

0.00457842 0.00390424 0.00947046 0.00410091 0.0022092 0.00292498

0.00638005 0.00796804 0.00140869 0.00887531 0.00496863 0.01049942

0.00908096 0.00332738 0.00799218 0.00228496 0.004639 0.00213413

0.00729368 0.01049243 0.00790528 0.01269368 -0.00425872 0.00256319

0.00859569 0.00472848 0.0007721 0.00191874 0.01546813 0.00144742

0.00888212 0.00648021 0.00115819 0.00351191 0.00580168 0.00614044

0.00632418 0.0040833 0.00346038 -0.00034315 0.00599405 0.00302578

0.0065765 0.01086897 0.00625799 0.00096572 0.00061766 0.00038494

0.00523901 0.00633054 0.00379964 0.00302567 -0.00123339 0.00153471

0.00725584 0.00836433 0.01295913 0.00737863]

@hcho3 살펴

잠깐만요, 제 재현에 무작위 시드를 설정하는 것을 잊었습니다. 바보 나.

고정 랜덤 시드로 재현을 업데이트했습니다. 버그가 여전히 지속됩니다. 업데이트된 재현을 XGBoost 1.0.0 및 1.1.0으로 실행해 보았는데 예측이 XGBoost 1.2.0의 예측과 일치합니다.

간단히 말해서:

Prediction from 1.0.0

== Prediction from 1.1.0

== Prediction from 1.2.0

!= Prediction from latest master

@trivialfis 예, 도움을 주시면 감사하겠습니다.

차단으로 표시합니다.

알았어요.

추적 a4ce0eae43f7e0e2f91566ef2360830b86b9fdcf . @ShvetsKS 한번 보실래요 ?

a4ce0ea 로 추적됩니다. @ShvetsKS 한번 보실래요 ?

확신하는. 파이썬 재생산기에서 모델을 훈련하는 데 도움을 줄 수 있습니까?

m2.load_model('xgb.model.bin') # load data

훈련에 사용되는 XGBoost 버전은 무엇이며 정확히 어떤 매개변수를 제공해야 합니까?

@ShvetsKS https://github.com/7starsea/xgboost-testing 에서 모델 파일 xgb.model.bin 을 얻을 수 있습니다 . 모델은 1.0.0으로 훈련되었습니다.

@ShvetsKS https://github.com/7starsea/xgboost-testing 에서 모델 파일

xgb.model.bin을 얻을 수 있습니다 . 모델은 1.0.0으로 훈련되었습니다.

모델은 실제로 1.2.1 및 매개변수로 훈련되었습니다.

param = {'max_depth': 8, 'eta': 0.1, 'min_child_weight': 2, 'gamma': 1e-8, 'subsample': 0.6, 'nthread': 4}

감사 해요.

작은 차이는 부동 소수점 연산의 순서가 변경되었기 때문인 것 같습니다.

_정확한 이유:_

a4ce0ea 전에 우리는 모든 나무 응답을 지역 변수 psum (초기 0과 동일)로 증가시키고 out_preds 에서 적절한 값을 증가시킵니다.

a4ce0ea에서 우리는 각 트리 응답에 의해 직접 out_preds 값을 증가시킵니다.

수정이 준비되었습니다: https://github.com/dmlc/xgboost/pull/6384

@7starsea 차이점을 찾아주셔서 감사합니다. 위의 수정 사항을 확인할 수 있습니까?

@hcho3 , @trivialfis 그런 차이가 미래에 중요하다고 생각하나요? 추론을 위해 부동 소수점 연산의 순서를 변경할 수 없다는 것이 중요한 제한인 것 같습니다. 그러나 훈련 단계에는 내가 기억하는 것과 같은 요구 사항이 없습니다.

우리는 그러한 차이를 미래에 중요하다고 생각합니까?

일반적으로 없습니다. 변경 사항을 살펴보겠습니다. ;-)

@ShvetsKS 방금 확인한 결과 차이는 이제 정확히 0입니다. 예측 차이를 수정해 주셔서 감사합니다.

@ShvetsKS

우리는 그러한 차이를 미래에 중요하다고 생각합니까? 추론을 위해 부동 소수점 연산의 순서를 변경할 수 없도록 하는 중요한 제한 사항인 것 같습니다.

실제로, 우리( @RAMitchell , @trivialfis 및 I)는 여기에 동의합니다. 예측의 정확한 재현성을 의무화하는 것은 변경을 수행하는 능력을 심각하게 방해할 것입니다. 부동 소수점 산술은 비연관으로 유명하므로 숫자 목록의 합은 덧셈 순서에 따라 약간씩 다릅니다.

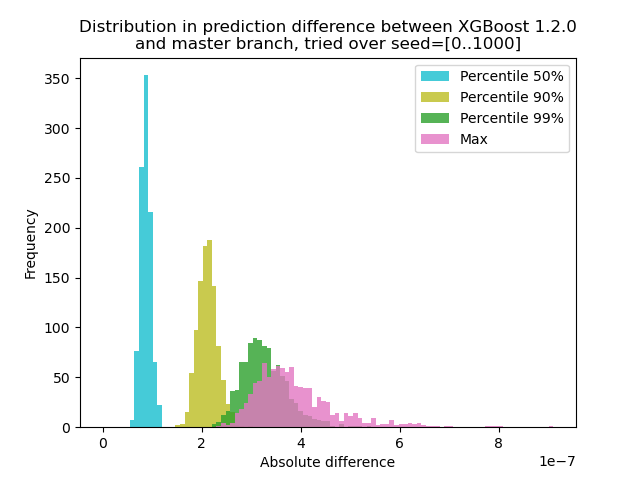

XGBoost 1.2.0과 최신 master 분기 간에 예측이 얼마나 변경되는지 정량화하는 실험을 실행했습니다.

1000개의 서로 다른 임의 시드로 데이터를 생성한 다음 버전 1.2.0과 마스터를 모두 사용하여 1000개의 행렬로 예측을 실행했습니다. 예측의 변화는 시드 사이에서 약간 바뀌지만 그 차이는 결코 9.2e-7보다 크지 않으므로 예측 변화는 논리 오류가 아닌 부동 소수점 산술로 인해 발생했을 가능성이 큽니다 .

실험용 스크립트

**test.py**: 다른 임의의 시드로 1000개의 행렬을 생성하고 이에 대한 예측을 실행합니다.

import numpy as np

import xgboost as xgb

import argparse

def main(args):

m2 = xgb.Booster({'nthread': '4'}) # init model

m2.load_model('xgb.model.bin') # load data

out = {}

for seed in range(1000):

rng = np.random.default_rng(seed=seed)

rx = rng.standard_normal(size=(100, 127 + 7 + 1))

rx = rx.astype(np.float32, order='C')

dtest = xgb.DMatrix(rx, missing=0.0)

out[str(seed)] = m2.predict(dtest)

np.savez(args.out_pred, **out)

if __name__ == '__main__':

parser = argparse.ArgumentParser()

parser.add_argument('--out-pred', type=str, required=True)

args = parser.parse_args()

main(args)

import numpy as np

import matplotlib.pyplot as plt

xgb120 = np.load('xgb120.npz')

xgblatest = np.load('xgblatest.npz')

percentile_pts = [50, 90, 99]

colors = ['tab:cyan', 'tab:olive', 'tab:green', 'tab:pink']

percentile = {}

for x in percentile_pts:

percentile[x] = []

percentile['max'] = []

for seed in range(1000):

diff = np.abs(xgb120[str(seed)] - xgblatest[str(seed)])

t = np.percentile(diff, percentile_pts)

for x, y in zip(percentile_pts, t):

percentile[x].append(y)

percentile['max'].append(np.max(diff))

bins = np.linspace(0, np.max(percentile['max']), 100)

idx = 0

for x in percentile_pts:

plt.hist(percentile[x], label=f'Percentile {x}%', bins=bins, alpha=0.8, color=colors[idx])

idx += 1

plt.hist(percentile['max'], label='Max', bins=bins, alpha=0.8, color=colors[idx])

plt.legend(loc='best')

plt.title('Distribution in prediction difference between XGBoost 1.2.0\nand master branch, tried over seed=[0..1000]')

plt.xlabel('Absolute difference')

plt.ylabel('Frequency')

plt.savefig('foobar.png', dpi=100)

여기서 문제는 float가 있는 + 가 그룹을 형성하지 않는다는 것이므로 합계를 제거하여 테스트할 수 있습니다. 단일 트리에서 예측합니다. 결과는 정확히 동일해야 합니다.

@trivialfis 실제로 ntree_limit=1 인수를 m2.predict() 에 추가하면 차이가 0으로 사라집니다.

엄청난! 그래서 다음은 그것을 문서화하는 방법 또는 문서화해야 하는지 여부입니다.

내가 자게 해줘. 현재로서는 이 문제가 실제로 버그가 아니라고 말하는 것으로 충분합니다.

가장 유용한 댓글

@ShvetsKS

실제로, 우리( @RAMitchell , @trivialfis 및 I)는 여기에 동의합니다. 예측의 정확한 재현성을 의무화하는 것은 변경을 수행하는 능력을 심각하게 방해할 것입니다. 부동 소수점 산술은 비연관으로 유명하므로 숫자 목록의 합은 덧셈 순서에 따라 약간씩 다릅니다.

XGBoost 1.2.0과 최신

master분기 간에 예측이 얼마나 변경되는지 정량화하는 실험을 실행했습니다.1000개의 서로 다른 임의 시드로 데이터를 생성한 다음 버전 1.2.0과 마스터를 모두 사용하여 1000개의 행렬로 예측을 실행했습니다. 예측의 변화는 시드 사이에서 약간 바뀌지만 그 차이는 결코 9.2e-7보다 크지 않으므로 예측 변화는 논리 오류가 아닌 부동 소수점 산술로 인해 발생했을 가능성이 큽니다 .

실험용 스크립트

**test.py**: 다른 임의의 시드로 1000개의 행렬을 생성하고 이에 대한 예측을 실행합니다.

명령: `python test.py --out-pred [out.npz]`. Python 환경에 올바른 버전의 XGBoost가 있는지 확인하십시오. `xgb120.npz`가 XGBoost 1.2.0에 대한 결과를 저장하고 `xgblatest.npz`가 최신 마스터에 대한 결과를 저장한다고 가정합시다. **compare.py**: 예측 차이에 대한 히스토그램 플롯 만들기